谷歌研究人員發布的一篇新論文在人工智能與計算領域投下了一枚“重磅炸彈”。該論文提出的關鍵技術,能夠將大型語言模型推理過程中占用大量內存的KV Cache壓縮高達6倍。這一突破性進展不僅直接影響了相關內存技術公司的股價,更被業界廣泛視為可能開啟一個類似“DeepSeek時刻”的新紀元,為大數據信息處理服務的效率與可及性帶來革命性提升。

一、 核心技術:理解KV Cache與內存瓶頸

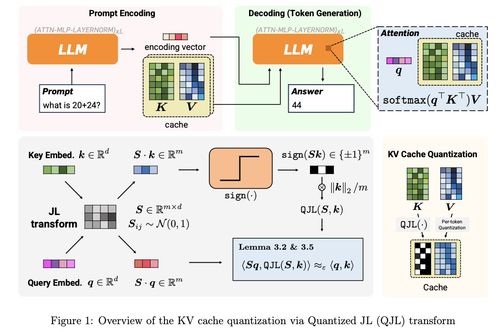

在大型語言模型(如GPT、PaLM等)的推理過程中,為了生成連貫的文本,模型需要記住之前所有生成的token的上下文信息。這部分信息通常以“鍵-值”(Key-Value,簡稱KV)對的形式緩存在內存中,稱為KV Cache。隨著生成長度的增加,KV Cache所占用的內存會線性甚至平方級增長,成為制約模型處理長文本、降低推理成本和提高吞吐量的主要瓶頸。尤其是在需要同時處理大量用戶請求的云服務場景下,內存消耗直接關聯著硬件成本和能源消耗。

二、 谷歌的突破:6倍壓縮如何實現?

谷歌論文的核心在于提出了一種高效、無損或高保真的KV Cache壓縮算法。其思路并非簡單粗暴地丟棄信息,而是通過創新的方法(可能涉及稀疏化、量化、結構化修剪或動態內存分配等高級技術)來識別并保留對后續生成最關鍵的那部分上下文信息,同時極大地壓縮或高效表示冗余或次要的信息。

關鍵優勢可能包括:

1. 高壓縮比:在保證模型輸出質量(困惑度)基本不變或僅有極小損失的前提下,實現高達6倍的內存占用減少。

2. 計算友好:壓縮與解壓過程對計算開銷的增加極小,不會顯著拖慢推理速度。

3. 即插即用:該方法可能無需對預訓練好的模型進行重新訓練或微調,可直接應用于現有模型的推理部署中,降低了應用門檻。

三、 市場震動:“內存股價”背后的邏輯

論文成果一經披露,立即在資本市場引發連鎖反應,部分內存芯片及存儲解決方案供應商的股價應聲下跌。這背后的邏輯清晰而直接:

- 需求預期變化:如果未來所有大模型服務提供商都采用此類技術,那么部署相同規模的AI服務所需的內存硬件總量將大幅減少,直接削弱了市場對高端內存(如HBM)長期增長的需求預期。

- 成本結構重塑:AI推理的成本中心可能從昂貴的內存硬件向其他方面轉移,改變了產業鏈的價值分配。

四、 開啟“谷歌的DeepSeek時刻”:大數據處理的新范式

“DeepSeek時刻”在此處是一個類比,意指像DeepSeek公司以其高性價比模型引發行業關注一樣,谷歌此項技術可能從基礎設施層面觸發AI應用普及的拐點。

對大數據信息處理服務的影響將是深遠的:

- 服務成本大幅降低:云服務商能夠以更低的硬件成本提供大模型API服務,最終可能降低企業及開發者的使用門檻。

- 長上下文處理成為常態:內存瓶頸的突破使得模型能夠更經濟地處理超長文檔、長對話歷史和多輪分析任務,極大地拓展了在金融分析、法律文檔審閱、長篇內容生成等領域的實用邊界。

- 實時性與吞吐量飛躍:在固定內存預算下,服務器能夠同時處理的用戶請求數(吞吐量)顯著增加,提升了高并發場景(如智能客服、實時翻譯)的服務質量。

- 邊緣部署成為可能:壓縮后的模型對內存的要求降低,使得在邊緣設備(如手機、物聯網終端)上運行更強大的模型變得更為可行,推動AI真正走向無處不在。

五、 展望與挑戰

盡管前景光明,但該技術走向大規模應用仍需面對一些挑戰:壓縮算法在不同模型架構和任務上的普適性、極端壓縮下輸出質量的長期穩定性、以及與現有推理軟件棧的集成優化等。這也將促使整個行業更加關注算法創新與硬件協同設計,而不僅僅是追逐參數規模的競賽。

總而言之,谷歌的這項研究不僅僅是一項技術優化,它更像是一把鑰匙,有可能打開高效、普惠AI計算時代的大門。它迫使行業重新審視AI算力的消耗模式,并將加速大數據信息處理服務向更高效、更廉價、更強大的方向演進。未來的AI服務,或許將不再如此“健忘”和“昂貴”,而這正是技術突破帶來的最直觀的福祉。